基于 OpenClaw 与 瑞芯微RV1126B 私有化部署飞书智能助手全流程

飞凌嵌入式

2026-03-20 13:00:00

RV1126B

OpenClaw

飞书部署

飞凌嵌入式

2026-03-20 13:00:00

RV1126B

OpenClaw

飞书部署

OpenClaw凭借出众的能力爆火出圈,如果将它集成到飞书中做成专属智能助手,能大幅提升日常办公效率,让文档总结、消息处理、任务协同更智能高效。想要稳定落地这一场景,一块靠谱的边缘硬件平台必不可少。

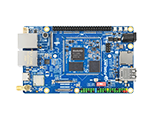

飞凌嵌入式OK1126B-S开发板

本方案基于瑞芯微RK1126B处理器打造的边缘AI视觉开发板,集成4个ARM Cortex-A53高性能核心,具备3TOPS@INT8的AI计算能力,可轻松完成端侧轻量化AI模型实时推理。性能高、功耗低、私密性强的特性,让它非常适合作为本地AI Agent的运行平台。

OK1126B-S开发板硬件接口示意图

系统推荐:使用Debian/Ubuntu等完整Linux发行版,方便通过apt安装依赖库与AI相关组件;不建议使用精简Linux(如Buildroot),否则在开发和部署过程中会增加环境搭建成本。

本文将为大家介绍本地私有化模型部署以及访问云端模型API的方法,完成基于RV1126B开发板飞书智能助手的全流程搭建。

一、OpenClaw安装与模型配置

1.1 安装OpenClaw

执行以下命令一键安装OpenClaw:

curl -fsSL https://openclaw.ai/install.sh | bash

安装完成后进入引导界面,若未自动弹出,可在终端输入以下命令手动启动:

openclaw onboard --install-daemon

进入引导界面后,依次选择:yes → QuickStart → Use existing values

OpenClaw初始化引导配置界面

若您有带NVIDIA GPU的服务器,可直接跳转到1.3适配本地模型章节,在您的服务器上部署免费的模型。

1.2 接入云端付费模型

进入模型选择界面,此处我们选择Qwen免费模型进行体验,若您拥有付费模型的API,可在此处选择对应的模型。

OpenClaw模型提供商选择列表

以接入Qwen模型为例,点击界面中的链接,登录后即可免费体验Qwen模型:

Qwen模型OAuth授权引导界面

1.3 接入本地模型

若选择云端模型API,可跳过此章节。本地模型部署基于Ollama实现,全流程如下:

1.3.1 服务器端安装Ollama

最低配置要求:

- 内存:4GB(适配1B-3B小模型)

- 存储:10GB空闲空间

- 系统:Linux/macOS 12+ /Windows 10+

推荐配置要求:

- 内存:16GB+(适配7B-14B模型)

- 显卡:NVIDIA 8GB+显存(支持GPU加速)

- 存储:50GB+SSD

执行以下命令安装Ollama:

curl -fsSL https://ollama.com/install.sh | sh

上述脚本会自动下载最新版本的Ollama,创建系统服务并启动后台进程。安装完成后,执行以下命令验证安装,输出版本号即为成功:

ollama --version

Ollama安装成功版本验证示例

1.3.2 修改Ollama service服务配置

Ollama服务默认运行在127.0.0.1上,无法满足远程调用需求,需修改对应service服务配置:

vi /etc/systemd/system/ollama.service

在[Service]区域添加以下配置:

Environment="OLLAMA_HOST=0.0.0.0"

Ollama service服务配置修改示例

修改完成后,执行以下命令重启服务:

sudo systemctl daemon-reload sudo systemctl restart ollama

1.3.3 下载并运行指定模型

执行以下命令,会自动下载指定模型并运行,此处我们选择qwen3.5-9b模型,您可根据实际服务器情况选择对应模型。

注:在https://ollama.com/library目录下,可查看Ollama支持的所有模型。

ollama run qwen3.5:9b

Ollama模型成功运行界面示例

此时,可在OK1126B-S开发板(基于RV1126B设计)上执行以下命令测试对话,正常情况下将得到模型返回的输出内容:

curl http://${服务器IP地址}:11434/api/chat -d '{"model": "qwen3.5:9b",

"messages": [

{"role": "user", "content": "你是谁"}

]

}'

1.3.4 OpenClaw配置文件修改

使用本地模型时,需手动修改OpenClaw的配置文件,步骤如下:

Step1:编辑OpenClaw配置文件

vi ~/.openclaw/openclaw.json

Step2:粘贴以下配置内容,并按Step3说明修改适配

{

"meta": {

"lastTouchedVersion": "2026.3.8",

"lastTouchedAt": "2026-03-12T01:44:37.610Z"

},

"wizard": {

"lastRunAt": "2026-03-12T01:44:37.566Z",

"lastRunVersion": "2026.3.8",

"lastRunCommand": "onboard",

"lastRunMode": "local"

},

"auth": {

"profiles": {}

},

"models": {

"providers": {

"ollama-remote": {

"baseUrl": "http://192.168.1.111:11434/v1",

"apiKey": "sk-no-key-required",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5:9b",

"name": "Qwen 3.5 9B (Remote Ollama)",

"reasoning": false,

"input": [

"text"

],

"cost": {

"input": 0,

"output": 0,

"cacheRead": 0,

"cacheWrite": 0

},

"contextWindow": 32768,

"maxTokens": 8192

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "ollama-remote/qwen3.5:9b"

},

"models": {

"ollama-remote/qwen3.5:9b": {

"alias": "qwen"

}

},

"workspace": "/root/.openclaw/workspace",

"compaction": {

"mode": "safeguard"

},

"maxConcurrent": 4,

"subagents": {

"maxConcurrent": 8

}

}

},

"tools": {

"profile": "coding"

},

"messages": {

"ackReactionScope": "group-mentions"

},

"commands": {

"native": "auto",

"nativeSkills": "auto",

"restart": true,

"ownerDisplay": "raw"

},

"session": {

"dmScope": "per-channel-peer"

},

"gateway": {

"port": 18789,

"mode": "local",

"bind": "loopback",

"auth": {

"mode": "token",

"token": "4893303352c56f5e9acbb076cc47c5398bb8df525fed4699"

},

"tailscale": {

"mode": "off",

"resetOnExit": false

},

"nodes": {

"denyCommands": [

"camera.snap",

"camera.clip",

"screen.record",

"contacts.add",

"calendar.add",

"reminders.add",

"sms.send"

]

}

},

"plugins": {

"entries": {}

}

}

Step3:配置字段修改适配说明

- models.providers 下面的 key 可自定义填写,示例中为 "ollama-remote";

- baseUrl 字段需填写服务器的地址,即1.3.3中使用curl测试时的地址,示例为 "http://192.168.1.111:11434/v1";

- apiKey 字段可任意填写,但不可为空;

- api 字段需根据模型的输出接口形式确定,ollama输出标准openai格式,故此处为 openai-completions;

- models 字段下的 id 需严格匹配 ollama 中的模型名,name 字段可自定义填写;

- agents 字段需修改 primary 字段以及 models 字段的 key 值,修改为 "models.providers 下的key / models.id",示例为 "ollama-remote/qwen3.5:9b"。

配置完成后,重新在命令行输入以下命令进入引导界面:

openclaw onboard

1.3.5 选择本地模型

进入模型选择阶段,直接选择Skip for now跳过即可。

OpenClaw模型选择跳过界面

后续筛选模型时,选择All providers,然后在默认模型选项中,选择Keep current,括号内会显示之前配置的本地模型。

OpenClaw本地模型默认选择界面

1.4 基础配置

以下基础配置仅适用于初次验证,无额外集成功能,按界面提示依次选择即可。

OpenClaw启动方式选择界面

OpenClaw通道选择界面

若为首次安装,会自动安装Gateway service;若非首次安装,选择Restart即可。

OpenClaw启动方式选择界面

首次安装完成后,会出现启动方式选择:TUI为终端命令行输入模式,Web UI为开发板连接显示器后通过Web界面操作。

OpenClaw启动方式选择界面

若未自动弹出启动方式选择界面,可手动输入以下命令进入终端对话模式:

openclaw tui

执行后即可正常与模型对话:

OpenClaw TUI终端对话界面示例

二、飞书智能助手部署全流程

2.1 创建飞书应用

进入飞书开发者后台:https://open.feishu.cn/app,点击"创建企业自建应用"。

飞书开发者后台创建企业自建应用入口

填写"应用名称"和"应用描述"后,点击"创建"按钮完成应用创建。

飞书企业自建应用创建信息填写界面

在"凭证与基础信息"栏目中,复制App ID以及App Secret,后续配置需要使用。

飞书应用凭证信息查看界面

2.2 OpenClaw飞书插件配置

在OK1126B-S开发板上输入以下命令,安装并启用飞书插件,查看插件状态:

openclaw plugins enable feishu openclaw plugins list

Feishu一栏显示Loaded即代表插件启动成功。

OpenClaw插件列表状态查看界面

执行以下命令进入通道配置界面,选择Yes:

openclaw channels add

OpenClaw飞书插件配置

在通道选择列表中,选择"Feishu/Lark(飞书)"。

OpenClaw飞书插件配置

选择"Enter App Secret",依次输入2.1步骤中复制的App Secret以及App ID。

OpenClaw飞书插件配置

设置连接模式为"WebSocket",并选择国内域名"Feishu (feishu.cn) -China"。

OpenClaw飞书插件配置

群聊策略选择"Open"(响应所有群聊,需@机器人),Allowlist策略仅响应白名单中的群聊,可按需选择。

OpenClaw飞书插件配置

点击"Finished",其余选项保持默认配置即可。

OpenClaw飞书插件配置

OpenClaw飞书插件配置

2.3 飞书机器人权限与事件配置

回到飞书开发者后台的应用界面,完成以下配置:

2.3.1 开启机器人能力

依次点击:添加应用能力→机器人,点击"添加"按钮,开启机器人能力。

飞书应用添加机器人能力界面

2.3.2 配置应用权限

依次点击:权限管理→批量导入/导出权限。

飞书应用权限管理界面

在批量导入/导出权限界面,粘贴以下JSON内容,启用对应权限:

{

"scopes": {

"tenant": [

"aily:file:read",

"aily:file:write",

"application:application.app_message_stats.overview:readonly",

"application:application:self_manage",

"application:bot.menu:write",

"cardkit:card:read",

"cardkit:card:write",

"contact:user.employee_id:readonly",

"corehr:file:download",

"event:ip_list",

"im:chat.access_event.bot_p2p_chat:read",

"im:chat.members:bot_access",

"im:message",

"im:message.group_at_msg:readonly",

"im:message.p2p_msg:readonly",

"im:message:readonly",

"im:message:send_as_bot",

"im:resource"

],

"user": ["aily:file:read", "aily:file:write", "im:chat.access_event.bot_p2p_chat:read"]

}

}

依次点击:下一步,确认新增权限 → 申请开通,完成权限配置。

飞书应用权限导入确认界面

2.3.3 配置事件订阅

依次点击:事件与回调 → 事件配置 → 订阅方式 → 使用长连接接收事件 → 保存。

飞书事件订阅方式配置界面

点击"添加事件",添加以下事件:

飞书添加事项配置界面

- im.message.receive_v1 - 接收消息

- im.message.message_read_v1 - 消息已读回执

- im.chat.member.bot.added_v1 - 机器人进群

- im.chat.member.bot.deleted_v1 - 机器人被移出群

2.3.4 发布应用版本

依次点击:版本管理与发布 → 创建版本,填写版本号和版本说明后,提交发布申请。

飞书应用版本创建与发布界面

注:个人版飞书应用发布免审,提交后自动通过并生效;企业版需企业管理员审核通过后生效。

2.4 功能测试

进入飞书APP端,点击右上角+号,创建群组。

飞书创建群组

依次点击右上角...进入群设置界面,选择添加机器人。

飞书群添加机器人界面

输入刚才创建的机器人名字后,添加机器人即可。

飞书群添加机器人界面

添加完成后,即可在飞书中@机器人进行对话,完成飞书智能助手的全流程部署。

飞书机器人对话测试效果示例

华北区负责人

华东区负责人

华南区负责人

中西区负责人

相关产品 >

-

FET1126BJ-S核心板

FET1126BJ-S核心板是飞凌嵌入式基于瑞芯微RV1126BJ处理器开发的国产化边缘AI计算平台。该处理器专为端侧及边缘侧AI应用场景打造,集成4核ARM Cortex-A53架构,提供高达3TOPS@INT8的AI算力,是智慧工业、智慧园区、智慧工地等场景实现视频分析与目标识别的优选方案 了解详情

-

OK1126BJ-S开发板

RV1126B开发板(型号:OK1126B-S)是飞凌嵌入式基于瑞芯微RV1126B处理器打造的国产化边缘AI计算平台。集成4核A53 CPU与3TOPS@INT8独立NPU,支持Linux 6.1系统,提供完整BSP与RKNN工具链,兼容TensorFlow/PyTorch主流框架。核心板采用邮票孔+LGA设计,支持-40℃~+85℃工业级宽温,配备MIPI-DSI、双网口、CAN-FD及树莓派兼容40Pin GPIO接口。尺寸仅120mm×75mm,专为智慧工业质检、园区安防、工地安全监测等端侧AI场景设计,提供10年供应保障与7×24小时技术支持。 了解详情